지인의 부탁으로 뭘 하느라 논문을 좀 읽었다. 그러면서 HR과 머신러닝이 만나는 지점에서 무슨 일이 벌어지고 있는지 알고 싶었다. 답은 의외의 곳에 있었다.

1. 첫 번째 질문: “직무만족을 예측할 수 있는가?”

직무만족은 오래된 주제다. 조직행동론의 단골 메뉴이고, HR 담당자라면 누구나 한 번쯤 설문지를 돌려본 적이 있다. 그런데 한 가지 이상한 점이 있다. 수십 년간 “무엇이 직무만족에 영향을 미치는가?”를 연구해왔으면서, 정작 “이 직원의 만족도가 내년에 어떻게 될까?”를 예측하는 연구는 거의 없다.

전통적인 분석은 OLS 회귀에 의존한다. 변수 A가 한 단위 올라가면 직무만족이 B만큼 올라간다. 깔끔하다. 직선 하나가 모든 것을 설명한다.

문제는 현실이 직선이 아니라는 것이다.

Somers, Birnbaum, and Casal (2021) 는 같은 데이터에 OLS와 인공신경망(ANN)을 동시에 돌려 보았다. 결과가 달랐다. 감독자의 지원이 직원 웰빙에 미치는 효과는 일정 수준까지는 올라가다가, 어느 지점을 넘으면 더 이상 올라가지 않았다. 체감 효과(diminishing returns). OLS는 이 꺾이는 지점을 전혀 포착하지 못했다. 직선에는 꺾임이 없으니까.

Roedenbeck and Poljsak-Rosinski (2023) 은 43,000명의 데이터에서 ANN이 R²>0.75를 달성하는 것을 확인했다. OLS 기준선을 명확하게 상회했다. Schulz et al. (2026) 는 509개 기업의 종단 데이터에서 더 놀라운 것을 발견했다. AI 도입과 직무만족 사이에 역 U자형 관계가 있었다. AI를 도입하면 만족도가 올라가다가, 과하게 도입하면 다시 떨어진다.

이것은 마치 약의 용량-반응 곡선과 같다. 적정량은 치료하지만, 과량은 독이 된다. 그리고 OLS 회귀는 이 곡선을 직선으로 펴버려서, 약이 “약간 효과가 있다”는 결론만 내놓는다. 실제로는 최적 투여량이 존재하는데도.

첫 번째 답은 이렇다. 머신러닝 모델은 직무만족을 예측할 수 있다. 그리고 전통적 OLS보다 더 잘 한다. 여러 연구에서 일관되게.

2. 두 번째 질문: “그런데, 왜 더 잘하는가?”

여기서 이야기가 꼬인다.

ML 모델이 OLS보다 정확하다는 건 알겠다. 하지만 왜 더 정확한지는 모른다. 랜덤 포레스트가 R²=0.85를 찍었다고 치자. HR 담당자가 물을 것이다. “그래서 뭘 어떻게 하라는 건가요?”

모델은 대답하지 않는다. 블랙박스니까.

여기서 우리는 “정확한 예측”과 “설명 가능한 예측” 사이의 긴장을 만난다. Benabou (2026) 는 이것을 정확도-해석가능성 상충 관계(accuracy-interpretability trade-off)라고 불렀다. 랜덤 포레스트와 XGBoost는 가장 정확하지만 가장 불투명하고, 의사결정 나무(CART)는 투명하지만 덜 정확하다.

53편의 문헌을 뒤졌을 때, 이 긴장을 해결한 연구는 두 편이었다. 딱 두 편.

Chaudhary (2025) 는 직원 이직 예측에서 SHAP이라는 도구를 썼다. SHAP은 게임 이론의 Shapley 값에서 온 기법으로, 각 변수가 예측에 얼마나 기여했는지를 수치로 분해한다. 비유하자면, 축구 경기에서 승리에 대한 각 선수의 한계 기여도를 산출하는 것과 같다. 골을 넣은 선수만이 아니라, 패스를 준 선수, 수비를 막은 선수, 팀 전술을 세운 감독까지, 각자의 기여분을 정확히 나눈다.

Sobrie (2024) 는 철도 관제 환경에서 LightGBM과 SHAP을 결합해 업무 부하를 실시간으로 예측하고 설명하는 시스템을 만들었다. 관제사에게 “당신이 지금 과부하 상태입니다”라고만 말하는 게 아니라, “이 열차 배정 패턴이 당신의 부하를 73% 설명합니다”라고 말해줄 수 있게 된 것이다.

두 연구의 수렴이 보여주는 것은 명확하다. SHAP 기반 XAI(설명 가능 AI)는 블랙박스를 열 수 있다. ML의 예측력은 유지하면서, “왜”를 설명할 수 있다.

하지만 — 여기가 핵심인데 — 두 연구 모두 직무만족을 대상으로 하지 않았다. 하나는 이직이고, 하나는 업무 부하다. 직무만족 예측에 SHAP을 적용한 연구는 아직까지 읽어본 바로는 없었다.

3. 세 번째 질문: “직무만족은 하나인가?”

이 질문이 모든 것을 바꾼다.

기존 연구 대부분은 직무만족을 단일 점수로 측정한다. “당신은 현재 직무에 얼마나 만족하십니까?” 1점에서 5점. 그런데 잠깐 생각해보자. 업무 자체는 좋아하는데 월급이 적은 사람과, 월급은 괜찮은데 동료 관계가 힘든 사람이 같은 점수를 줄 수 있다. 3점이라는 숫자 뒤에 완전히 다른 이야기가 숨어 있다.

직무만족에는 적어도 세 개의 하위 차원이 있다.

- 업무 내용 만족: 일 자체가 의미 있는가?

- 임금 만족: 보상이 공정한가?

- 대인관계 만족: 함께 일하는 사람들과의 관계가 좋은가?

이 세 가지를 결정하는 요인이 같을까? 직관적으로도 다르다. 그런데 이것을 ML로 분리 예측하고, SHAP으로 각 차원의 핵심 요인을 비교한 연구는 존재하지 않는다.

여기서 직무 요구-자원(JD-R) 이론이 등장한다. 이 이론은 원래 번아웃과 동기부여를 설명하기 위해 만들어졌다. 직무 자원(자율성, 상사 지원, 성장 기회)은 동기를 올리고, 직무 요구(과부하, 시간 압박, 감정 노동)는 에너지를 소진시킨다. 단순하지만 강력한 프레임이다.

이 이론을 직무만족 하위 차원에 비틀어 적용하면 흥미로운 예측이 가능해진다. 업무 내용 만족은 직무 자원 중에서도 자율성과 역량 개발이 핵심일 것이다. 임금 만족은 보상 공정성이 지배할 것이다. 대인관계 만족은 사회적 지원과 팀 응집력이 결정할 것이다.

이것은 이론적 추측이다. 아직 실증되지 않았다. 하지만 만약 SHAP 분석이 이 예측을 지지한다면, 우리는 두 가지를 동시에 얻는다. ML 모델이 왜 예측하는지에 대한 답과, JD-R 이론이 하위 차원 수준에서도 작동한다는 실증적 근거를.

4. 네 번째 질문: “공정한 예측인가?”

ML이 직무만족을 예측할 수 있다. 좋다. SHAP이 이유를 설명할 수 있다. 더 좋다. 그런데 한 가지가 남았다.

그 예측이 공정한가?

Fabris et al. (2024) 의 경고는 직접적이다. AI 기반 채용 시스템은 특정 집단에 대한 구조적 차별을 재생산할 수 있다. 학력이 높은 남성이 “만족도가 높을 것”이라고 예측하는 모델이 있다면, 그것은 예측이 아니라 편견의 자동화다.

Zheng et al. (2025) 은 AI-HRM 시스템의 네 가지 “그림자 경험”을 발견했다. 대인 자율성의 침식, 감시가 유발하는 불안정성, 알고리즘 편향 딜레마, 개인화된 불만족. AI가 HR을 돕기 위해 도입되었는데, 오히려 직원의 자율성을 갉아먹을 수 있다는 역설이다.

그러나 Deng et al. (2025) 의 발견은 이 비관론에 균형을 제공한다. 알고리즘 모니터링이 조직 공정성 지각을 통해 직원 웰빙을 향상시킬 수 있다는 것이다. 단, 조건이 있다. 투명할 때. 알고리즘이 왜 그런 판단을 내렸는지 직원이 이해할 수 있을 때.

SHAP이 바로 이 투명성의 도구다. “당신의 임금 만족도가 낮다고 예측된 이유는, 동일 직군 대비 보상 수준(기여도 42%)과 성과 평가 투명성(기여도 28%)이 주요 요인입니다.” 이렇게 설명할 수 있다면, 직원은 알고리즘을 적으로 여기지 않는다. 오히려 자기 상황을 이해하는 도구로 받아들인다.

마치 건강 검진과 같다. “콜레스테롤 수치가 높습니다”라고만 하면 불안하다. 하지만 “LDL이 160인데, 이것은 주로 포화지방 섭취(기여도 45%)와 운동 부족(기여도 30%)에 의한 것이고, 식이 조절로 3개월 내 개선 가능합니다”라고 하면 행동으로 이어진다. SHAP 기반 직무만족 설명은 조직판 건강 검진 결과서인 셈이다.

5. 빈 자리: 한국은 어디에?

유럽, 북미, 동남아, 중동의 기업 데이터가 있었다. 한국은 없었다.

정확히 말하면, 한국 인적자본기업패널(HCCP) 데이터를 활용한 ML 기반 직무만족 예측 연구는 단 한 편도 없었다. Kim (2025) 이 한국 식품서비스 산업의 구인 포털 텍스트를 분석했지만, 이것은 텍스트 데이터이지 HCCP의 다차원 설문 구조가 아니다.

이 공백이 단순한 미검증 영역이 아닌 이유가 있다.

한국 조직은 다르다. 높은 권력 거리와 위계적 문화 속에서, 감독자-부하 관계의 질은 서구 맥락보다 훨씬 더 강한 예측 변수일 수 있다. 정규직-비정규직 이중 구조에서, 고용 형태가 임금 만족을 결정하는 핵심 경계 조건일 수 있다. MZ세대와 베이비붐 세대가 같은 사무실에서 일하면서, 세대 간 직무만족의 구조 자체가 다를 수 있다.

서구에서 확인된 패턴이 한국에서도 재현되리라는 보장은 없다. Xiao, Yan, and Bamber (2025) 가 제안한 “AI HR 분석 → 직무 조각(job crafting) → 회복탄력성” 경로에서, 직무 조각이라는 행위 — 자신의 직무를 능동적으로 재설계하는 것 — 의 문화적 수용성은 권력 거리가 높은 한국 조직에서 서구보다 낮을 수 있다. 이 문화적 조절 효과는 HCCP 기반 연구가 아니면 검증이 불가능한 고유한 질문이다.

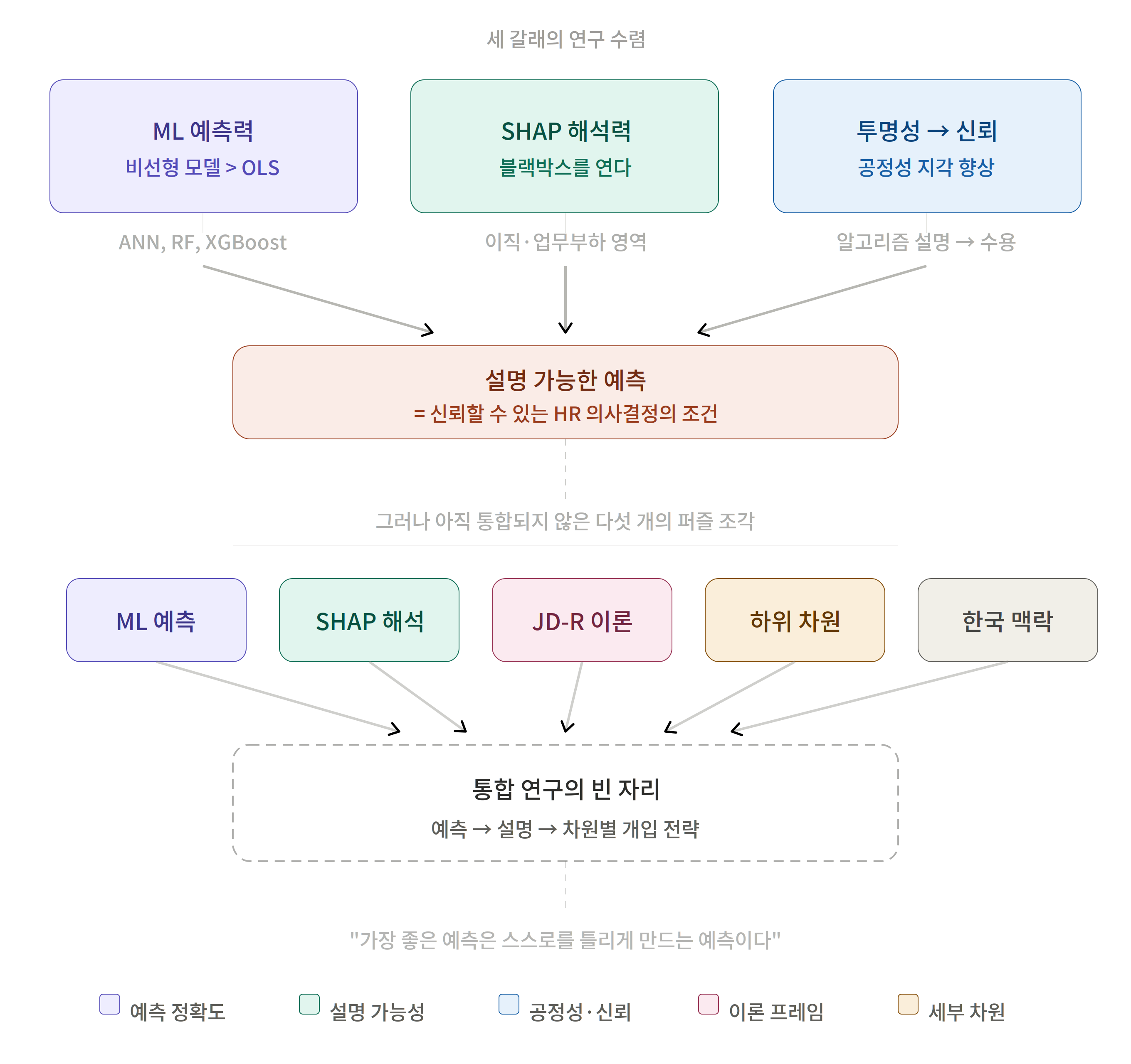

6. 다섯 가지 방법론이 같은 곳을 가리킨다

패턴들을 모아보면, 놀랍도록 일관된 그림이 나타난다.

첫 번째 수렴: ML은 OLS보다 예측을 잘 한다. ANN (Somers, Birnbaum, and Casal 2021), ANN 대규모 (Roedenbeck and Poljsak-Rosinski 2023), GBM/XGBoost (Seo 2026), 랜덤 포레스트 (Gupta et al. 2023), 멀티모달 딥러닝 (Yang 2025). 알고리즘이 달라도, 데이터가 달라도, 결론은 같다. 비선형 모델이 직무만족의 복잡한 역동을 더 정확하게 포착한다.

두 번째 수렴: SHAP은 블랙박스를 열 수 있다. 이직 예측 (Chaudhary 2025), 업무 부하 예측 (Sobrie 2024). 서로 다른 도메인에서, 서로 다른 모델에서, SHAP은 HR 실무자가 신뢰할 수 있는 설명을 생성했다.

세 번째 수렴: 투명성이 신뢰를 만든다. 조직 공정성 연구 (Deng et al. 2025), 플랫폼 노동 연구 (Jabagi 2025), 의사결정 지원 실험 (Langer, Koenig, and Busch 2021). 알고리즘이 설명 가능할 때, 직원의 공정성 지각과 수용성이 올라간다.

세 줄기의 연구가 하나의 결론으로 수렴한다. 설명 가능한 예측이 신뢰할 수 있는 HR 의사결정의 조건이다.

그러나 이 세 줄기를 하나의 연구 안에서 통합한 사람은 아직 없다. ML 예측 + SHAP 해석 + JD-R 이론 + 직무만족 하위 차원 + 한국 맥락. 이 다섯 개의 퍼즐 조각이 맞춰지면, 우리는 “직원이 왜 불만족하는지”를 숫자로 예측하고, 이유를 설명하고, 차원별로 개입 전략을 제시할 수 있다.

7. 끝이 아니라 시작이다

이 글의 결론을 깔끔하게 요약하고 싶은 유혹이 있다. “ML이 좋고, SHAP이 필요하고, 한국 연구가 시급하다.” 맞는 말이지만 충분하지 않다.

더 도발적인 질문이 남아 있다.

ML 모델이 직무만족을 정확히 예측하게 된 세상에서, HR의 역할은 무엇이 되는가? “이 직원은 6개월 내 만족도가 하락할 것이다”라는 예측을 받아든 관리자는 무엇을 해야 하는가? 그리고 그 개입이 모델의 예측을 무효화한다면 — 개입 덕분에 만족도가 하락하지 않았다면 — 모델은 “틀린” 것인가, “성공한” 것인가?

예측의 역설이다. 가장 좋은 예측은 스스로를 틀리게 만드는 예측이다.

그리고 마지막 질문. SHAP이 “임금이 만족도의 42%를 설명한다”고 보여줬을 때, 조직은 정말 임금을 올릴 것인가? 데이터가 불편한 진실을 말해줄 때, 의사결정자는 데이터를 따를 것인가, 아니면 대시보드를 끌 것인가?

기술의 문제가 아니다. 설명 가능한 AI가 던지는 것은 결국 조직의 의지에 대한 질문이다.